Muchos pacientes que pierden la capacidad de habla por una enfermedad neurológica (ictus, lesión traumática cerebral, Parkinson, esclerosis múltiple o lateral amiotrófica, entre otras) dependen de dispositivos de comunicación basados en interfaces cerebro-ordenador o del uso de movimientos no verbales de la cabeza o los ojos para controlar un cursor y seleccionar letras con las que deletrean palabras. Son procesos imperfectos, que permiten unas diez palabras por minuto, frente a la velocidad normal del habla humana, que alcanza las 100-150 palabras por minuto.

Edward Chang, de la Universidad de California San Francisco, es el primer autor de un estudio que se publica en Nature donde se presenta un sistema para sintetizar el habla de una persona utilizando las señales cerebrales relacionadas con los movimientos de la mandíbula, laringe, labios y lengua. La investigación ha estado también coordinada por el neurocientífico Gopala Anumanchipalli y Josh Chartier, bioingeniero en el laboratorio de Chang.

El sintetizador de habla.

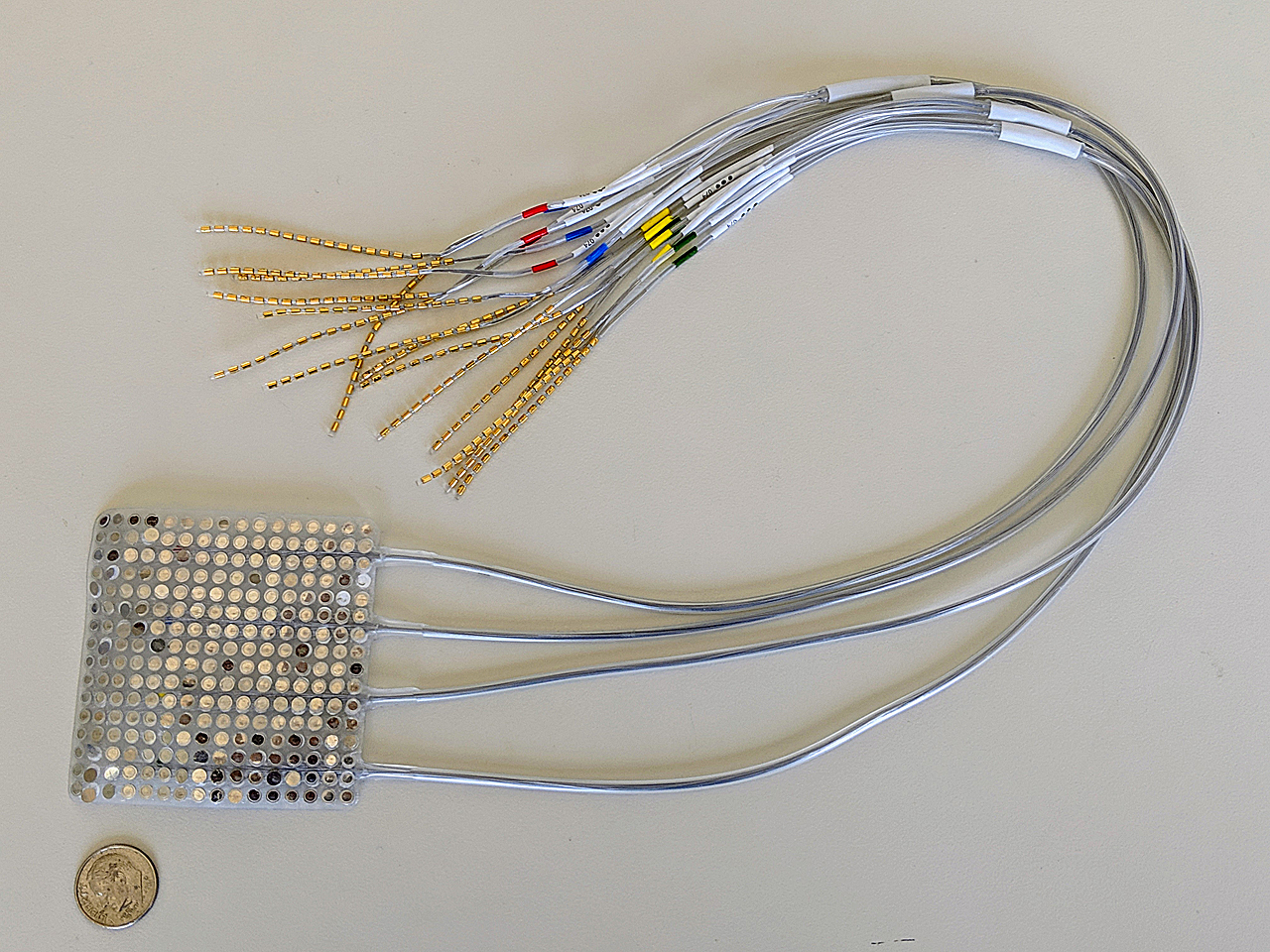

El dispositivo recoge la actividad eléctrica de la corteza cerebral mediante una electrocorticografía (ECoG), por la que se implantan unos electrodos intracraneales. Para desarrollar este decodificador, los electrodos se implantaron en cinco participantes, cuya habla no estaba afectada, que se tenían que someter a una cirugía para controlar la epilepsia.

Los investigadores primero registraron la actividad cortical de los cerebros de los participantes mientras pronunciaban cientos de oraciones en voz alta. Usando estas grabaciones, diseñaron un sistema capaz de decodificar las señales cerebrales responsables de los movimientos individuales del tracto vocal. Así pudieron sintetizar el habla a partir de los movimientos decodificados. En las pruebas de 101 oraciones, los oyentes podían identificar y transcribir fácilmente el discurso sintetizado.

En otras pruebas, se pidió a un participante que enunciara las oraciones y luego las imitara, haciendo los mismos movimientos articulatorios pero sin emitir sonido. Si bien el rendimiento de la síntesis del habla sin sonido fue inferior a la del habla audible, los autores concluyen que es posible descodificar características del habla que nunca se hayan dicho en voz alta.

“Por primera vez, este estudio demuestra que podemos generar oraciones habladas enteras basadas en la actividad cerebral de un individuo”, afirma Chang. “Es una prueba de concepto estimulante; con la tecnología que ya estamos desarrollando, podríamos ser capaces de obtener un dispositivo clínicamente viable en pacientes que han perdido la capacidad de habla”.

En un artículo, también en Nature, sobre este estudio, Chethan Pandarinath y Yahia Ali, de la Universidad de Emory, escriben que aunque los autores han logrado una prueba de concepto convincente, aún quedan muchos desafíos que superar antes de que pueda convertirse en un interfaz cerebro-ordenador clínicamente viable.

The post Un nuevo dispositivo sintetiza el habla a partir de señales cerebrales appeared first on Diariomedico.com.

via Noticias de diariomedico.... http://bit.ly/2vk2j70

No hay comentarios:

Publicar un comentario